Gli Agenti AI Hanno Bisogno di Prompt Migliori: Perché la Gestione dei Prompt Conta nell'Era degli Agenti

Il 12 marzo 2026, il CEO di Y Combinator Garry Tan ha rilasciato in open source un repository chiamato gstack: una collezione di 13 file di prompt specializzati che simulano un'intera organizzazione ingegneristica all'interno di Claude Code [1]. In cinque giorni, il repository aveva accumulato 23.100 stelle su GitHub e 2.700 fork [2]. La reazione è stata polarizzata. I sostenitori lo hanno definito uno sguardo sul futuro; i critici lo hanno liquidato come "un mucchio di prompt in un file di testo" [2].

Entrambe le parti hanno mancato il punto.

La stessa settimana, il CEO di Shopify Tobi Lutke ha rivelato che un agente di coding, guidato da un singolo file autoresearch.md e una suite di test, aveva prodotto 93 commit attraverso 120 esperimenti automatizzati, ottenendo un miglioramento delle performance del 53% su Liquid, il motore di template ventennale di Shopify [3]. Il codebase era stato ottimizzato da centinaia di contributori nell'arco di due decenni. Un file di prompt e un pomeriggio hanno ottenuto ciò che anni di tuning incrementale non avevano raggiunto.

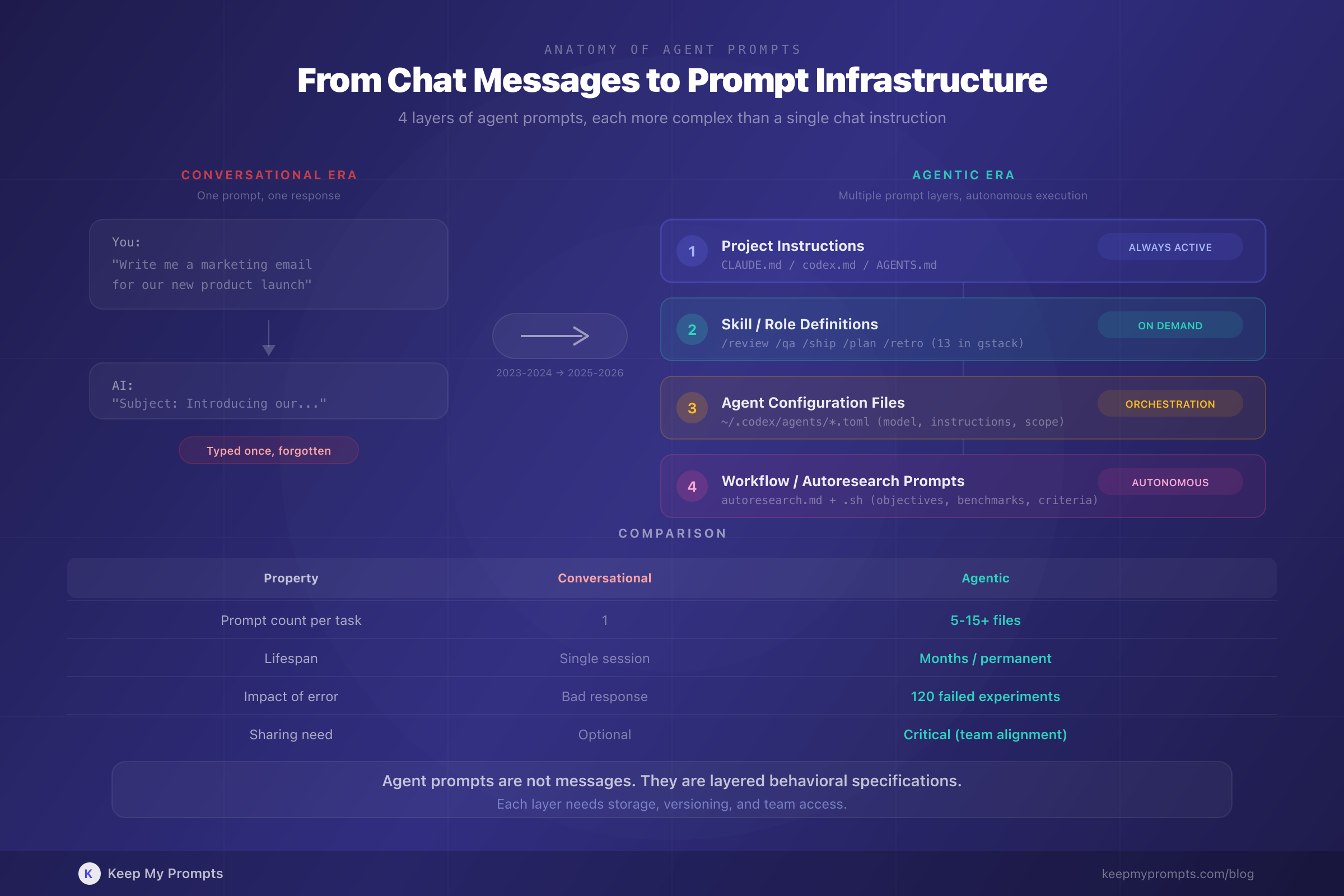

Non sono eventi isolati. Segnalano un cambiamento strutturale nel modo in cui i professionisti interagiscono con l'AI. Stiamo passando da un mondo in cui i prompt vengono scritti una volta e dimenticati a uno in cui i prompt sono infrastruttura: versionati, condivisi, specializzati e determinanti per i risultati. L'ascesa degli agenti AI, assistenti di coding che operano autonomamente attraverso workflow multi-step, rende questo cambiamento irreversibile.

Questo articolo esplora perché i workflow basati su agenti richiedono un approccio fondamentalmente diverso alla gestione dei prompt, come si presenta nella pratica, e perché i professionisti che organizzano i propri prompt come gli ingegneri organizzano il codice supereranno chi non lo fa.

1. Dalla Chat agli Agenti: Cosa È Cambiato

1.1 L'Era Conversazionale

Per la maggior parte del 2023 e 2024, interagire con l'AI significava digitare un prompt in una finestra di chat e ricevere una risposta. Il prompt era effimero. Potevi raffinarlo nel corso di qualche scambio, ma l'interazione era fondamentalmente sincrona e usa-e-getta. Se scrivevi un ottimo prompt per generare copy di marketing, forse lo avresti incollato di nuovo la settimana successiva, o forse non lo avresti ricordato affatto.

Questo modello funzionava perché lo scope era limitato. Un prompt, un task, una risposta.

1.2 Il Cambio di Paradigma: gli Agenti

Nel 2025 e 2026, il pattern di interazione dominante è cambiato. Agenti AI di coding come Claude Code, OpenAI Codex, Gemini CLI e Mistral Vibe [4] hanno introdotto un paradigma diverso: dai all'agente un obiettivo, e lui pianifica, esegue, testa e itera autonomamente, richiamando tool, leggendo file, eseguendo comandi e scrivendo codice attraverso step multipli.

Il prompt non è più una singola istruzione. È un livello di configurazione che determina come l'agente si comporta lungo un intero workflow. Simon Willison, parlando al Pragmatic Engineering Summit nel marzo 2026, ha descritto un momento cardine: "il momento in cui l'agente scrive più codice di te" [5]. Per molti professionisti, quel momento è già arrivato.

1.3 La Scala dell'Adozione

Il pattern dei subagent, dove un agente primario delega task ad agenti specializzati, è oggi supportato da almeno sette tool principali: OpenAI Codex, Claude Code, Gemini CLI, Mistral Vibe, OpenCode, Visual Studio Code e Cursor [4]. Codex di OpenAI ha introdotto il supporto formale ai subagent nel marzo 2026, con tre agenti predefiniti ("explorer," "worker," "default") e la possibilità di definire agenti personalizzati come file di configurazione TOML [4].

Non si tratta di un workflow di nicchia per sviluppatori. Al NICAR 2026, una conferenza di giornalismo, i giornalisti di dati hanno completato un workshop di tre ore utilizzando agenti di coding per analizzare un database di 200.000 alberi di San Francisco, generare heat map interattive e fare scraping di dati web. Costo totale in token API: 23 dollari [6].

2. L'Anatomia dei Prompt per Agenti

I prompt per agenti sono strutturalmente diversi dai prompt conversazionali. Comprendere questa differenza è essenziale per gestirli efficacemente.

2.1 System Prompt e Istruzioni di Progetto

Ogni sessione di un agente inizia con un system prompt o un file di istruzioni del progetto. In Claude Code, questo è il CLAUDE.md; in Codex, è il codex.md o AGENTS.md. Questi file definiscono il comportamento dell'agente, i vincoli e la conoscenza del progetto. Sono l'equivalente della documentazione di onboarding per un nuovo membro del team, con la differenza che questo membro del team li legge perfettamente ogni volta.

Willison ha descritto la sua apertura standard: "ecco come eseguire il test, di solito è uv run pytest" seguito da "usa red-green TDD." Lo ha definito "cinque token" [5]. Quei cinque token attivano in modo affidabile il comportamento test-driven development per un'intera sessione di coding. L'economia dell'istruzione nasconde il suo impatto.

2.2 File di Skill e Definizioni di Ruolo

Il gstack di Garry Tan porta questo concetto oltre. Ognuna delle sue 13 skill è un file .md separato memorizzato in ~/.claude/skills/gstack/, referenziato tramite il CLAUDE.md del progetto [1]. Le skill codificano ruoli organizzativi:

| Skill | Ruolo |

|---|---|

/plan-ceo-review | Strategia di prodotto e visione |

/plan-eng-review | Architettura e pianificazione tecnica |

/plan-design-review | Audit del design (checklist di 80 punti) |

/review | Code review e rilevamento bug |

/qa | Test QA con correzione bug |

/ship | Release management e CI/CD |

/retro | Metriche settimanali e retrospettive |

Ogni file è un prompt. Ogni prompt codifica un comportamento specializzato. Insieme, simulano un team: strategia, design, engineering, code review, QA, rilascio, documentazione [1]. Le 23.100 stelle suggeriscono che l'industria concorda sul valore di questo approccio.

2.3 File di Configurazione degli Agenti

Codex di OpenAI memorizza le definizioni di agenti personalizzati come file TOML in ~/.codex/agents/, ognuno con istruzioni specifiche e un modello assegnato [4]. Un prompt multi-agente dalla loro documentazione recita:

"Indaga perché il modal delle impostazioni non salva. Fai riprodurre il problema a browser_debugger, fai tracciare il percorso del codice responsabile a code_mapper, e fai implementare la correzione minima a ui_fixer una volta chiara la modalità di errore." [4]

Questo non è un prompt che scrivi una volta. È una definizione di workflow riutilizzabile che coordina tre agenti specializzati. Perderlo significa ricostruire l'intera orchestrazione da zero.

2.4 Prompt di Autoresearch

L'approccio di Shopify rappresenta un'altra categoria. Il file autoresearch.md, combinato con autoresearch.sh, ha fornito all'agente tutto il necessario per eseguire 120 esperimenti di ottimizzazione autonomamente [3]. Il prompt definiva l'obiettivo, la metodologia di benchmark, i comandi di test e i criteri di successo. Lo stato veniva mantenuto in autoresearch.jsonl.

Il risultato: 53% più veloce nel parsing e rendering, 61% in meno di allocazioni di memoria [3]. Il file di prompt era l'artefatto critico. Senza di esso, l'agente non avrebbe avuto un framework per la sperimentazione autonoma.

3. Perché i Prompt degli Agenti Hanno Bisogno di Gestione

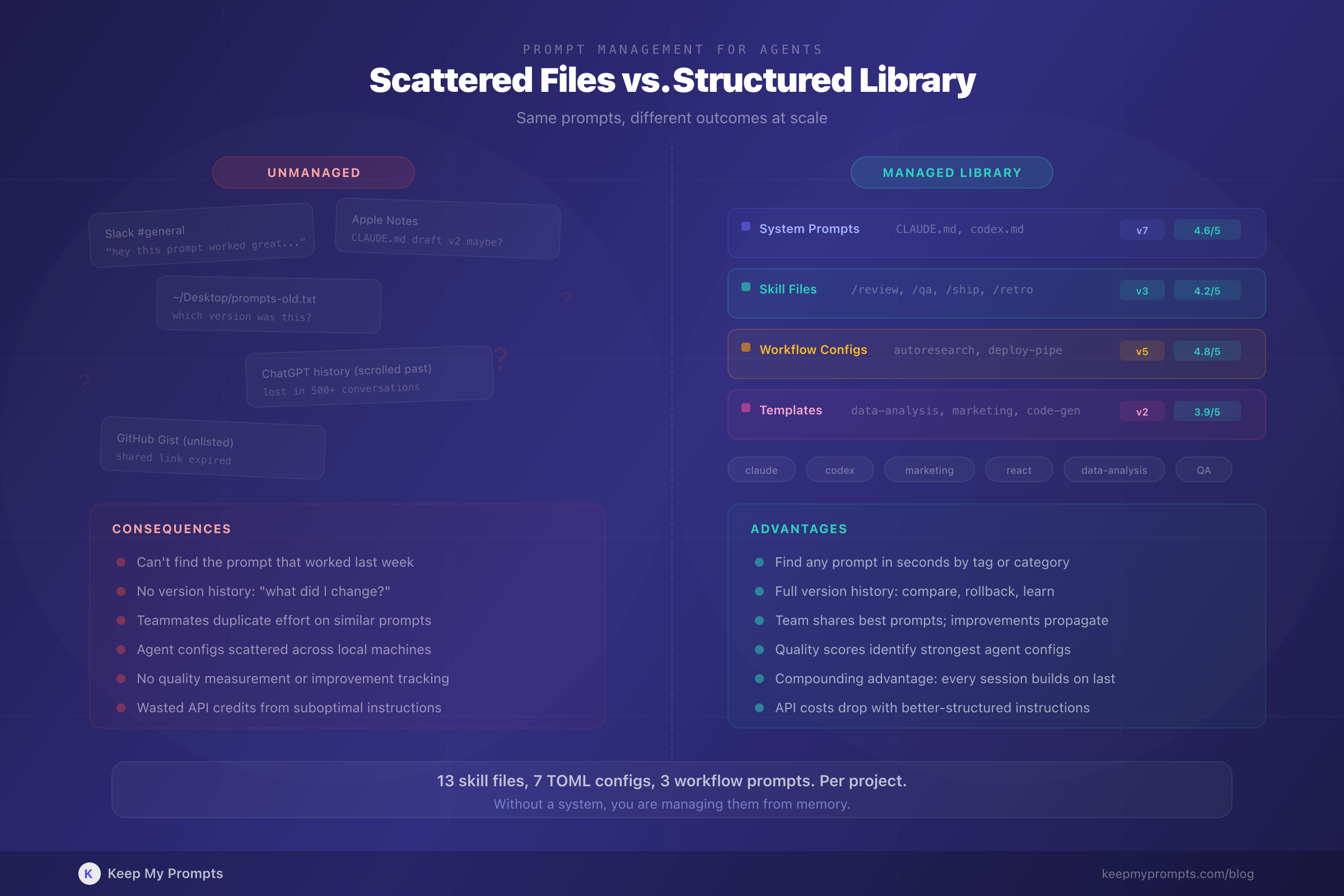

3.1 Proliferazione

Un singolo progetto che utilizza agenti di coding potrebbe ora richiedere:

- Un file di istruzioni del progetto (

CLAUDE.mdocodex.md) - Multipli file di skill o definizioni di agenti (

.mdo.toml) - File di prompt per autoresearch o workflow

- System prompt per contesti diversi (sviluppo, review, deployment)

- Template di prompt per task ricorrenti

Il setup di Garry Tan coinvolge 13 file di skill [1]. Un team che usa Codex con subagent personalizzati potrebbe avere una dozzina di definizioni TOML. Ogni file è un prompt che plasma il comportamento dell'agente. Ognuno deve essere memorizzato, versionato e accessibile quando serve.

3.2 Versionamento

I prompt degli agenti evolvono. Willison ha notato che gli agenti di coding "seguono i pattern esistenti del codebase quasi alla lettera" [5], il che significa che le istruzioni che dai all'inizio di una sessione si compongono nel tempo. Un piccolo cambiamento a un system prompt, aggiungere un'istruzione di testing, cambiare l'assegnazione di un modello, modificare una checklist di qualità, può produrre risultati drammaticamente diversi.

Senza cronologia delle versioni, non puoi rispondere alla domanda: "Cosa è cambiato tra la sessione che ha funzionato e quella che non ha funzionato?"

È lo stesso problema che l'ingegneria del software ha risolto con Git decenni fa. Il versionamento dei prompt è l'equivalente del controllo di versione per i workflow AI. Tracciare i cambiamenti dei prompt nel tempo non è più opzionale quando i tuoi prompt guidano agenti autonomi.

3.3 Condivisione nel Team

Quando il CEO di Shopify Tobi Lutke ha stabilito nell'aprile 2025 che "l'uso riflessivo dell'AI è ora un'aspettativa di base" e che i dipendenti devono giustificare perché un task non può essere completato con l'AI prima di richiedere risorse aggiuntive [7], ha creato un bisogno organizzativo di infrastruttura condivisa per i prompt. Ogni membro del team ha bisogno di accesso ai prompt che funzionano, e quei prompt devono essere consistenti.

Il gstack di Garry Tan è condivisibile by design: clona il repository, esegui il setup, aggiungi una riga al tuo CLAUDE.md [1]. Ma la maggior parte dei team non pubblica i propri prompt come repository open source. Ha bisogno di sistemi interni per condividere configurazioni degli agenti, file di skill e prompt di workflow tra i membri del team.

3.4 La Fallacia del "Sono Solo Prompt"

I critici di gstack hanno sostenuto che fosse "solo prompt in un file di testo" [2]. Questa lettura rivela un'incomprensione di cosa siano diventati i prompt. Un file CLAUDE.md non è un messaggio di chat. È una specifica comportamentale che determina come un sistema autonomo opera attraverso centinaia di azioni.

Liquidare i file di prompt come banali è come liquidare i file di configurazione come banali. Entrambi codificano decisioni critiche. Entrambi rompono le cose quando sono sbagliati. Entrambi hanno bisogno di gestione.

4. Guida Pratica: Gestire i Prompt per Workflow Agentici

4.1 Categorizza per Funzione

I prompt degli agenti servono funzioni diverse e vanno organizzati di conseguenza:

- System prompt: Istruzioni a livello di progetto (

CLAUDE.md,codex.md) - Prompt di ruolo: Definizioni di agenti specializzati (code reviewer, tester QA, architetto)

- Prompt di workflow: Definizioni di processi multi-step (autoresearch, pipeline di deployment)

- Prompt template: Pattern riutilizzabili per task ricorrenti (analisi dati, generazione contenuti)

- Prompt conversazionali: Prompt tradizionali a singolo turno per interazioni chat

Una libreria di prompt ben organizzata che distingue queste categorie previene la confusione di trattare tutti i prompt come intercambiabili.

4.2 Versiona Tutto

Ogni volta che modifichi un system prompt o una configurazione dell'agente, salva la versione precedente. La differenza tra un'esecuzione dell'agente riuscita e una fallita è spesso una singola istruzione aggiunta o rimossa.

La cronologia delle versioni permette:

- Rollback: Ripristina il prompt che funzionava quando quello nuovo non va

- Confronto: Identifica quali cambiamenti hanno prodotto quali risultati

- Apprendimento: Traccia come i tuoi prompt migliorano nel tempo

Ecco perché il versionamento dei prompt è una funzionalità core della gestione professionale dei prompt, non un nice-to-have.

4.3 Tagga per il Recupero

Man mano che la tua libreria di prompt cresce, la ricercabilità diventa critica. Tagga i prompt per:

- Tool AI: Claude Code, Codex, Gemini CLI, ChatGPT

- Dominio: marketing, engineering, analisi dati, design

- Tipo: system prompt, file di skill, workflow, template

- Progetto: Associa i prompt a progetti o repository specifici

Quando ti serve il file di skill QA che ha funzionato per il tuo progetto React il mese scorso, dovresti poterlo trovare in secondi, non in minuti.

4.4 Misura la Qualità

Non tutti i prompt sono uguali. I sei criteri di qualità dei prompt, chiarezza, contesto, task-output framing, role prompting, chain of thought e few-shot examples, si applicano con forza ancora maggiore ai prompt degli agenti, perché le conseguenze di un prompt mal strutturato si compongono attraverso ogni azione che l'agente esegue.

Un system prompt con istruzioni vaghe potrebbe produrre risultati accettabili in un singolo scambio di chat. La stessa vaghezza in una configurazione dell'agente che esegue 120 esperimenti autonomamente [3] può sprecare ore e crediti API.

4.5 Condividi nel Team

Se il tuo team usa agenti AI, ogni membro beneficia dall'accesso ai prompt che producono i migliori risultati. Stabilisci una libreria di prompt condivisa dove:

- I system prompt per i progetti comuni sono accessibili a tutti i membri del team

- Le configurazioni degli agenti sono standardizzate (così l'agente QA di un membro si comporta come quello di un altro)

- I miglioramenti ai prompt si propagano a tutti, non solo alla persona che li ha fatti

L'alternativa è che ogni membro del team mantenga la propria collezione isolata di file di prompt, senza modo di imparare dai raffinamenti degli altri.

4.6 Tratta i Prompt Come Codice

La traiettoria è chiara. I prompt stanno passando da testo casuale a infrastruttura gestita. I professionisti e i team che li trattano di conseguenza, memorizzandoli, versionandoli, categorizzandoli, misurandoli e condividendoli sistematicamente, avranno un vantaggio composto rispetto a chi non lo fa.

Willison ha osservato che i template di progetto (repository in stile cookiecutter) sono diventati una forma di prompt engineering: gli agenti seguono i pattern esistenti del codebase "quasi alla lettera" [5]. La struttura che crei oggi diventa l'istruzione che l'agente segue domani.

5. Il Segnale dalla C-Suite

Vale la pena notare chi sta guidando questo cambiamento. Non sviluppatori junior che sperimentano su progetti personali. CEO.

Tobi Lutke, CEO di Shopify (capitalizzazione di mercato: 150+ miliardi di dollari), ha personalmente eseguito l'esperimento autoresearch che ha ottimizzato Liquid [3]. Ha poi imposto l'adozione dell'AI a livello aziendale come criterio nelle valutazioni delle performance [7].

Garry Tan, CEO di Y Combinator (l'acceleratore di startup più influente al mondo), ha personalmente scritto e rilasciato in open source 13 file di skill per agenti, dichiarato un output di 10.000-20.000 righe di codice utilizzabili al giorno, e pubblicato retrospettive settimanali che tracciano 140.751 righe aggiunte in 362 commit in una singola settimana [1] [2].

Non sono endorsement teorici. Sono impegni operativi da parte di leader che stanno scommettendo le loro organizzazioni sui workflow guidati da agenti. Quando il CEO scrive i file di prompt, la gestione dei prompt non è un ripensamento. È strategia.

Conclusione

Il passaggio dall'AI conversazionale all'AI agentica cambia cosa sia un prompt. Non è più una domanda che fai a un chatbot. È una specifica comportamentale, una definizione di ruolo, una configurazione di workflow, una checklist di qualità. È infrastruttura.

Le evidenze del solo marzo 2026 lo rendono chiaro: 23.100 stelle su un repository di file di prompt [1]; 53% di miglioramento delle performance da un esperimento autonomo guidato da prompt [3]; orchestrazione di subagent supportata su sette tool principali [4]; 23 dollari in token per insegnare ai giornalisti l'analisi dati con gli agenti [6].

I professionisti che riconoscono questo cambiamento per tempo, che costruiscono librerie di prompt strutturate, versionano le configurazioni dei propri agenti, categorizzano per funzione e condividono nel team, accumuleranno il loro vantaggio con ogni sessione di agente. Chi tratta i prompt come usa-e-getta continuerà a reinventare i propri workflow da zero.

La domanda non è più se usi l'AI. È se gestisci le istruzioni che la guidano.

Riferimenti

[1] G. Tan. "gstack." GitHub, marzo 2026. github.com/garrytan/gstack

[2] TechCrunch. "Why Garry Tan's Claude Code setup has gotten so much love, and hate." TechCrunch, 17 marzo 2026.

[3] S. Willison. "Shopify/liquid performance improvements." simonwillison.net, 13 marzo 2026.

[4] S. Willison. "Use subagents and custom agents in Codex." simonwillison.net, 16 marzo 2026.

[5] S. Willison. "Agentic Engineering." Pragmatic Engineering Summit, 14 marzo 2026. simonwillison.net

[6] S. Willison. "Coding agents for data analysis." NICAR 2026 Workshop, 16 marzo 2026. simonwillison.net

[7] T. Lutke. Memo interno sull'adozione AI a Shopify. The Verge, aprile 2025.

[8] OpenAI. "Codex: Subagents and Custom Agents." OpenAI Documentation, marzo 2026.

[9] Anthropic. "Claude Code Documentation." docs.anthropic.com, 2026.

[10] A. Karpathy. "Autoresearch: Automated coding experiments." GitHub, 2026.

[11] S. Willison. "1M context now generally available for Opus 4.6." simonwillison.net, 13 marzo 2026.

[12] Mistral AI. "Mistral Forge: Build Your Own AI." mistral.ai, marzo 2026.