Introduzione

All'inizio del 2024, IEEE Spectrum ha pubblicato un articolo dal titolo provocatorio: "AI Prompt Engineering Is Dead" [1]. La tesi era che i modelli linguistici sanno ottimizzare i propri prompt meglio degli esseri umani, mettendo in dubbio un'intera disciplina emergente. Un anno dopo, Andrej Karpathy e il CEO di Shopify Tobi Lutke hanno reso popolare un nuovo termine: "context engineering" [2][3]. A febbraio 2026, uno studio peer-reviewed con 9.649 esperimenti ha confermato quello che i professionisti avevano cominciato a sospettare: la qualita' del contesto che circonda un prompt conta piu' del prompt stesso [4].

La narrazione e' convincente. Per certi versi importanti, e' anche fuorviante.

Questo articolo esamina la relazione tra prompt engineering e context engineering con la specificita' che il dibattito merita. Vedremo cosa significa davvero context engineering, cosa dice la ricerca, perche' il titolo "il prompt engineering e' morto" travisala realta', e cosa dovrebbero fare i professionisti. La risposta, come nella maggior parte dei dibattiti binari in tecnologia, non e' l'uno o l'altro. Sono entrambi, nelle giuste proporzioni, con la giusta infrastruttura.

1. Cos'e' il Context Engineering (davvero)

1.1 Una definizione operativa

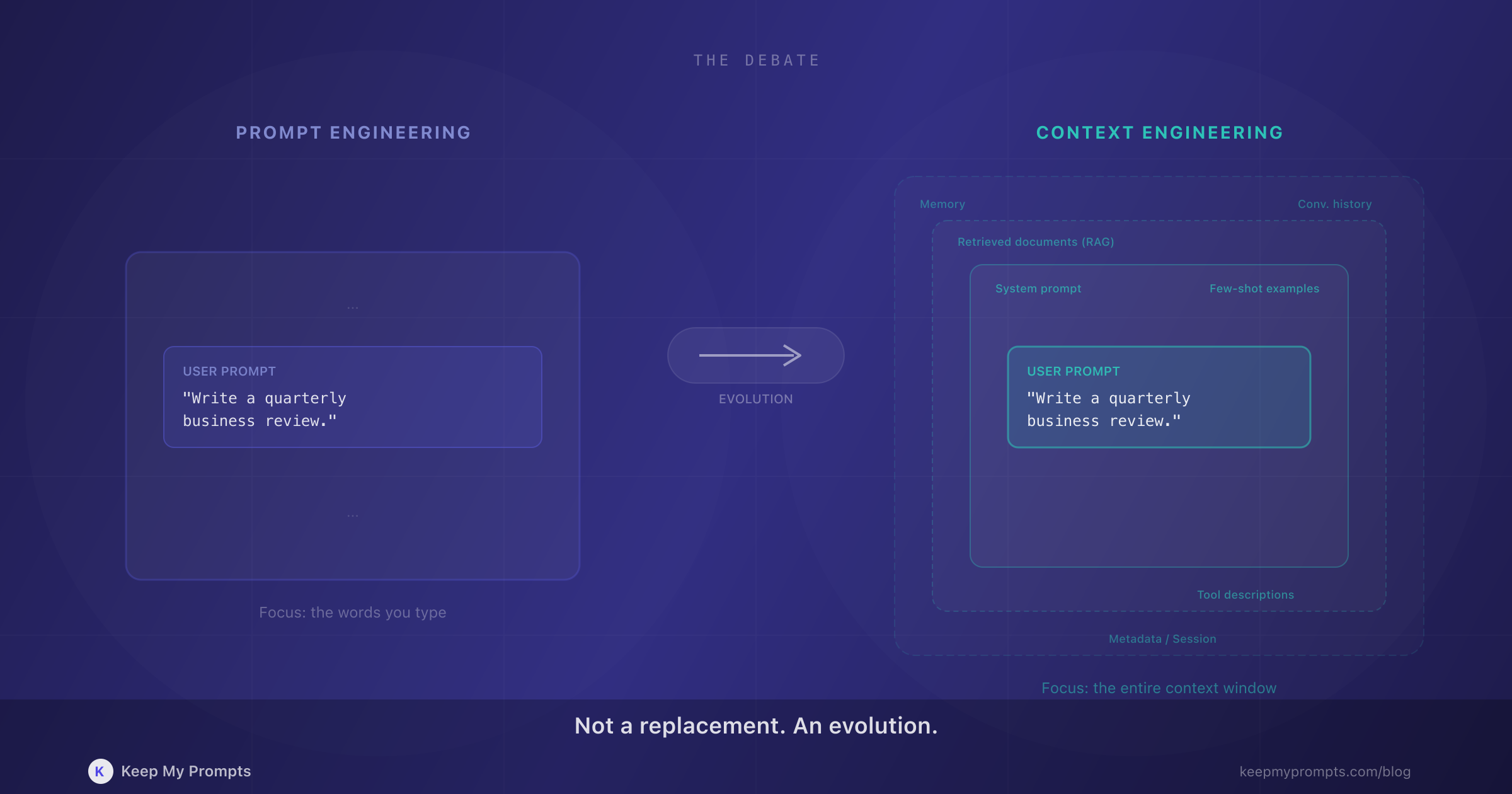

Il context engineering e' la pratica di progettare tutte le informazioni che un modello linguistico riceve, non solo il prompt dell'utente. Questo include system prompt, cronologia della conversazione, documenti recuperati (RAG), descrizioni degli strumenti, archivi di memoria, esempi few-shot e qualsiasi metadato che influenzi il comportamento del modello.

La definizione di Karpathy coglie bene il concetto: "l'arte e la scienza delicata di riempire la finestra di contesto con esattamente le informazioni giuste per il passo successivo" [2]. Lutke l'ha inquadrata dal punto di vista del professionista: "l'arte di fornire tutto il contesto necessario perche' il compito sia plausibilmente risolvibile dall'LLM" [3].

La distinzione dal prompt engineering e' una questione di ambito. Il prompt engineering si concentra sull'input lato utente: l'istruzione, la domanda, la descrizione del compito. Il context engineering comprende tutto cio' che si trova nella finestra di contesto, inclusi elementi che l'utente finale non vede e non controlla direttamente.

1.2 I componenti del contesto

Un modo utile per comprendere il context engineering e' fare un inventario di cosa entra in una finestra di contesto moderna:

| Componente | Esempio | Chi lo controlla |

|---|---|---|

| System prompt | Definizione del ruolo, vincoli comportamentali | Sviluppatore |

| Prompt utente | Il compito o la domanda effettiva | Utente |

| Cronologia conversazione | Messaggi precedenti nella sessione | Sistema |

| Documenti recuperati | Risultati RAG, estratti dalla knowledge base | Sistema (pipeline di retrieval) |

| Descrizioni strumenti | API disponibili, firme delle funzioni | Sviluppatore |

| Esempi few-shot | Coppie input/output che dimostrano il comportamento desiderato | Sviluppatore o utente |

| Memoria | Preferenze utente, interazioni passate | Sistema (layer di memoria) |

| Metadati | Timestamp, ruolo utente, tipo di sessione | Sistema |

Il prompt engineering, nella sua definizione tradizionale, riguarda principalmente una riga di questa tabella: il prompt utente. Il context engineering le riguarda tutte e otto.

1.3 Lo studio con 9.649 esperimenti

A febbraio 2026, Damon McMillan ha pubblicato "Structured Context Engineering for File-Native Agentic Systems," il primo studio empirico su larga scala di come la struttura del contesto influenzi le prestazioni degli agenti LLM [4]. Lo studio ha testato 11 modelli su 4 formati (YAML, Markdown, JSON, TOON) con schemi da 10 a 10.000 tabelle.

Il risultato chiave: per i modelli di frontiera (Claude, GPT, Gemini), il recupero del contesto basato su file ha migliorato l'accuratezza del 2,7% (p=0,029). I risultati sono stati pero' misti per i modelli open-source (aggregato -7,7%, p<0,001). L'implicazione e' significativa: la struttura del contesto conta, ma il suo impatto dipende dalla capacita' del modello di sfruttare informazioni strutturate.

Quello che il paper non dice, nonostante come sia stato citato negli articoli divulgativi, e' che i prompt non contano. Gli esperimenti hanno tenuto costante la qualita' del prompt per isolare gli effetti del contesto. Il risultato e' che la struttura del contesto aggiunge valore sopra a buoni prompt, non che li sostituisce.

2. Perche' la tesi "Il Prompt Engineering e' Morto" e' fuorviante

2.1 Cosa dicono davvero i critici

L'articolo di IEEE Spectrum [1] avanzava una tesi specifica: i modelli AI possono ottimizzare i propri prompt, producendo a volte istruzioni "cosi' bizzarre che nessun umano le avrebbe mai pensate." L'argomento riguardava l'ottimizzazione automatica dei prompt su scala, non il fatto che gli umani debbano smettere di ragionare sulle proprie istruzioni.

La ricerca di Stanford sul Verbalized Sampling [5] avanzava una tesi ancora piu' circoscritta: il training di allineamento causa un "mode collapse" negli output dei modelli, e i meta-prompt possono recuperare la distribuzione probabilistica completa. La conclusione dei ricercatori stessi era esplicita: "il prompt engineering non e' morto; sta finalmente diventando una scienza."

Nessuno dei due studi sostiene che scrivere istruzioni chiare, strutturate e contestualizzate sia inutile. Entrambi sostengono che la disciplina sta maturando oltre i trucchi per tentativi ed errori.

2.2 La distinzione tra enterprise e individuo

La conversazione sul context engineering e' guidata principalmente da team enterprise che costruiscono sistemi ad agenti, pipeline RAG e workflow multi-step. Il report "State of Agent Engineering" di LangChain 2025 ha rilevato che il 57% delle organizzazioni ha agenti AI in produzione, con il 32% che cita la qualita' come barriera principale [6]. In quel mondo, il context engineering e' assolutamente critico: il system prompt, la pipeline di retrieval, le descrizioni degli strumenti e l'architettura della memoria determinano se un agente riesce o fallisce.

Ma la maggior parte degli utenti AI non costruisce sistemi ad agenti. Scrivono prompt in ChatGPT, Claude o Gemini per bozze di email, analisi dati, generazione di contenuti o risoluzione di problemi. Per questi utenti, il prompt E' il contesto principale. Non c'e' una pipeline RAG, nessuna orchestrazione di strumenti, nessun layer di memoria. C'e' una persona, un campo di testo e un modello linguistico.

Dire a questi utenti che "il prompt engineering e' morto" e' come dire a un romanziere che scrivere buone frasi non conta perche' le case editrici hanno workflow editoriali.

2.3 La falsa dicotomia

L'inquadramento del context engineering che "sostituisce" il prompt engineering crea un falso binario. Consideriamo cosa richiede in pratica il context engineering:

- I system prompt sono prompt. Necessitano della stessa chiarezza, specificita' e struttura dei prompt utente.

- Il retrieval RAG dipende da quanto bene sono formulate le query, il che e' un problema di prompt engineering.

- Le descrizioni degli strumenti sono istruzioni al modello, scritte in linguaggio naturale, secondo principi di prompt design.

- Gli esempi few-shot sono una tecnica fondamentale di prompt engineering incorporata nel contesto.

Il context engineering non elimina il bisogno di buoni prompt. Moltiplica il numero di punti dove serve un buon prompt design. Un system prompt scritto male all'interno di una pipeline RAG sofisticata produrra' risultati scadenti a prescindere da quanto funzioni bene il retrieval.

3. La vera relazione tra contesto e prompt

3.1 Il contesto amplifica la qualita' del prompt

La relazione tra contesto e prompt e' moltiplicativa, non additiva. Un prompt ben costruito in un contesto ricco produce risultati drasticamente migliori di uno dei due elementi da solo. Un prompt mediocre in un contesto eccellente resta inferiore a un prompt forte nello stesso contesto.

Consideriamo un esempio pratico. Vuoi che un'AI scriva una business review trimestrale.

Prompt scadente, senza contesto:

Scrivi una business review trimestrale.

Buon prompt, senza contesto:

Scrivi una business review del Q4 2025 per un'azienda SaaS B2B. Includi sezioni su performance dei ricavi, metriche clienti, milestone di prodotto e outlook strategico. Usa un tono professionale ma diretto. Massimo 1.500 parole.

Buon prompt, contesto ricco:

Scrivi una business review del Q4 2025 per un'azienda SaaS B2B. Includi sezioni su performance dei ricavi, metriche clienti, milestone di prodotto e outlook strategico. Usa un tono professionale ma diretto. Massimo 1.500 parole.

Contesto: ARR cresciuto da 4,2M a 5,1M EUR. Net revenue retention al 118%. Lanciate due feature principali (assistente AI e workspace di team). Churn calato dal 3,2% al 2,1%. Assunti 12 dipendenti, team portato a 47 persone. Il board vuole vedere un percorso verso 10M EUR ARR entro Q4 2026.

La terza versione non e' migliore perche' il contesto ha sostituito il prompt. E' migliore perche' un prompt strutturato (secondo i principi TCOF: Task, Context, Output, Format) si e' combinato con dati di contesto rilevanti per produrre un risultato specifico, fondato e azionabile.

3.2 L'analogia della biblioteca

Context engineering e prompt engineering stanno tra loro come una biblioteca e i libri che contiene. Una biblioteca ben organizzata (contesto) con libri scritti male (prompt) non e' utile. Una collezione di libri eccellenti ammucchiati senza catalogazione (buoni prompt, nessuna struttura contestuale) e' frustrante da navigare. L'eccellenza richiede entrambi: contenuti ben scritti organizzati in un sistema recuperabile.

Questa analogia si estende a come i professionisti gestiscono le proprie interazioni AI nel tempo. I prompt che scrivi sono i libri. Le categorie in cui li organizzi, i tag che assegni, le note che aggiungi, le versioni che tracci: quella e' l'architettura della biblioteca. Quello e' context engineering a livello individuale.

3.3 I sei criteri continuano a valere

Che tu stia scrivendo un prompt utente o progettando un system prompt per una pipeline ad agenti, le stesse dimensioni di qualita' contano. La ricerca identifica costantemente sei criteri che separano i prompt efficaci da quelli inefficaci: chiarezza, ricchezza di contesto, allineamento TCOF, role prompting, struttura chain-of-thought, ed esempi few-shot.

Il context engineering non introduce nuovi criteri di qualita'. Introduce nuovi punti dove quei criteri devono essere applicati. Un system prompt valutato su queste sei dimensioni funzionera' meglio di uno scritto senza consapevolezza strutturale, esattamente come un prompt utente.

4. Come praticare il context engineering oggi

Non serve costruire un framework ad agenti o deployare una pipeline RAG per beneficiare dei principi del context engineering. L'intuizione centrale, che informazioni organizzate e ben strutturate attorno ai tuoi prompt migliorano i risultati, si applica a qualsiasi scala. Ecco cinque pratiche che funzionano sia per il professionista singolo che per un team.

4.1 Organizza i prompt per dominio e funzione

Quando raggruppi i prompt in categorie (content marketing, analisi dati, code review, comunicazioni clienti), stai costruendo domini di contesto. Ogni categoria rappresenta un cluster di conoscenze correlate, assunzioni condivise e pattern comuni. La prossima volta che lavori in quel dominio, i prompt circostanti servono come contesto di riferimento che informa e migliora il tuo nuovo prompt.

Ecco perche' una libreria di prompt ben organizzata supera in prestazioni una raccolta sparsa di messaggi salvati. L'organizzazione non e' overhead amministrativo; e' architettura del contesto.

4.2 Aggiungi metadati che catturano il contesto

Tag, note e descrizioni non sono lavoro inutile. Sono metadati contestuali che rendono i prompt recuperabili e riutilizzabili. Un prompt taggato con #onboarding, #enterprise, #tono-formale porta con se' un contesto che il solo testo del prompt non ha. Tra sei mesi, quei metadati fanno la differenza tra trovare il prompt giusto in pochi secondi e passare dieci minuti a ricostruirlo a memoria.

La ricerca lo conferma. Gli studi di knowledge management mostrano costantemente che i sistemi informativi ricchi di metadati superano in prestazioni quelli che si affidano alla sola ricerca full-text [7]. Lo stesso principio vale per le raccolte di prompt.

4.3 Versiona i tuoi prompt quando il contesto evolve

I modelli AI cambiano. I requisiti di business cambiano. Quello che funzionava con GPT-4 a gennaio potrebbe richiedere aggiustamenti per Claude a marzo. Trattare i prompt come artefatti statici equivale a mantenere un codebase senza version control.

La cronologia delle versioni serve a due scopi nel context engineering. Primo, preserva le configurazioni funzionanti cosi' puoi tornare indietro se un aggiornamento degrada le prestazioni. Secondo, documenta come la tua comprensione del compito si e' evoluta, il che e' di per se' una forma di contesto istituzionale. La progressione dalla v1 alla v5 di un prompt racconta una storia su cosa hai imparato e perche' hai cambiato approccio.

4.4 Valuta e perfeziona sistematicamente

La valutazione soggettiva ("questo prompt sembra funzionare") non scala. Lo scoring quantitativo su criteri specifici fornisce diagnostiche azionabili. Un prompt che ottiene 2,1 sulla ricchezza di contesto non ha bisogno di una riscrittura; ha bisogno di piu' informazioni di sfondo. Un prompt con 4,8 sulla chiarezza ma 1,5 sugli esempi few-shot ha una lacuna specifica e risolvibile.

Lo scoring sistematico trasforma il miglioramento dei prompt da un'arte a una pratica ingegneristica, che e' esattamente la traiettoria che il movimento del context engineering promuove.

4.5 Costruisci una knowledge base, non una cronologia di chat

Il cambiamento fondamentale del context engineering e' dal transitorio al persistente. Le cronologie di chat spariscono. I messaggi salvati perdono il contesto. Gli screenshot non sono cercabili. Un sistema dedicato alla gestione dei prompt, dove i prompt sono archiviati, categorizzati, taggati, versionati e valutati, e' una knowledge base personale che accumula valore nel tempo.

Questo e' cio' che separa i professionisti che migliorano costantemente da quelli che raggiungono un plateau: l'infrastruttura per accumulare e organizzare quello che imparano. Ogni prompt che salvi con metadati appropriati e' un mattone per il contesto futuro. Ogni versione che tracci e' un record di iterazione. Ogni categoria che definisci e' un confine di contesto che ti aiuta a ragionare piu' chiaramente su quali informazioni appartengono a cosa.

5. Cosa significa per il futuro

5.1 Dai prompt singoli ai sistemi context-aware

La traiettoria e' chiara. I prompt individuali si stanno evolvendo in librerie di prompt, che si stanno evolvendo in sistemi context-aware. Il Model Context Protocol (MCP), introdotto da Anthropic e adottato nell'industria, fornisce l'infrastruttura perche' i modelli accedano dinamicamente a fonti di contesto esterne [8]. I professionisti che hanno organizzato i propri prompt in raccolte strutturate, categorizzate e ricche di metadati stanno costruendo le fondamenta che questi sistemi sfrutteranno.

5.2 Le competenze che si trasferiscono

Se hai imparato a scrivere prompt chiari e strutturati seguendo framework come il TCOF, hai gia' sviluppato la competenza fondamentale che il context engineering richiede. La capacita' di specificare un compito con precisione, fornire contesto rilevante, definire l'output atteso e strutturare il formato: queste non sono competenze di prompt engineering che il context engineering rende obsolete. Sono le competenze fondamentali che il context engineering applica su scala piu' ampia.

5.3 Il vantaggio cumulativo

I professionisti che beneficeranno di piu' dell'era del context engineering non sono quelli che abbandonano il prompt engineering. Sono quelli che hanno costruito librerie di prompt organizzate, versionate e valutate fin dall'inizio. Perche' quando gli strumenti e le piattaforme di context engineering matureranno, la materia prima di cui hanno bisogno e' esattamente cio' che una libreria di prompt ben mantenuta fornisce: prompt di alta qualita', categorizzati, ricchi di metadati, con cronologia delle versioni, pronti per essere assemblati in architetture di contesto piu' ampie.

Conclusione

Il context engineering e' l'evoluzione naturale del prompt engineering, non la sua sostituzione. Le competenze sono complementari, e la relazione e' gerarchica: il context engineering e' la disciplina piu' ampia che include il prompt engineering come componente fondamentale.

La narrazione "il prompt engineering e' morto" e' una provocazione utile per i team enterprise che devono pensare oltre i prompt singoli. E' fuorviante per i milioni di professionisti che interagiscono con l'AI attraverso campi di testo ogni giorno e i cui risultati dipendono direttamente da quanto bene formulano le proprie istruzioni.

Il percorso pratico e' chiaro. Scrivi prompt migliori. Organizzali per dominio. Taggali con metadati contestuali. Versionali man mano che la tua comprensione evolve. Valutali secondo criteri oggettivi. Costruisci una knowledge base che diventa piu' utile nel tempo.

Questo e' context engineering. E inizia con un singolo prompt ben scritto.

Riferimenti

[1] Bhaskar, A. "AI Prompt Engineering Is Dead." IEEE Spectrum, marzo 2024. https://spectrum.ieee.org/prompt-engineering-is-dead

[2] Karpathy, A. Post su X (ex Twitter), giugno 2025. "+1 for 'context engineering' over 'prompt engineering'. [...] context engineering is the delicate art and science of filling the context window with just the right information for the next step." https://x.com/karpathy/status/1937902205765607626

[3] Lutke, T. Post su X (ex Twitter), giugno 2025. "I really like the term 'context engineering' over prompt engineering. It describes the core skill better: the art of providing all the context for the task to be plausibly solvable by the LLM." https://x.com/tobi/status/1935533422589399127

[4] McMillan, D. "Structured Context Engineering for File-Native Agentic Systems: Evaluating Schema Accuracy, Format Effectiveness, and Multi-File Navigation at Scale." arXiv:2602.05447, febbraio 2026. https://arxiv.org/abs/2602.05447

[5] Ricerca Stanford sul Verbalized Sampling, come riportata in "RIP Prompt Engineering? Why Verbalized Sampling Changes Everything." Analytics Vidhya, ottobre 2025. https://www.analyticsvidhya.com/blog/2025/10/verbalized-sampling/

[6] LangChain. "State of Agent Engineering 2025." Sondaggio su 1.340 rispondenti, novembre-dicembre 2025. https://www.langchain.com/state-of-agent-engineering

[7] Panopto. "Workplace Knowledge and Productivity Report." Studio che rileva che i knowledge worker trascorrono 5,3 ore settimanali cercando informazioni gia' esistenti nella propria organizzazione.

[8] Anthropic. "Model Context Protocol (MCP)." Standard aperto per connettere modelli AI a fonti di dati e strumenti esterni. https://modelcontextprotocol.io